在人工智能浪潮席卷全球的今天,基础软件开发构成了这场技术革命的核心引擎。从深度学习框架、模型库到开发工具链,基础软件不仅是实现AI算法和应用的关键载体,更是决定AI系统效率、可靠性和演进方向的基石。伴随着AI技术以空前的深度和广度融入社会生产与生活,其发展所依赖的海量数据与复杂计算,也带来了前所未有的数据安全挑战。如何在推动技术创新的构筑坚实的数据安全防线,已成为人工智能领域必须解答的时代命题。

一、 人工智能基础软件的基石作用

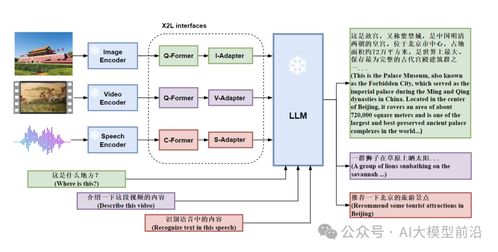

人工智能基础软件为整个AI生态提供了开发、训练、部署和管理的标准化环境。主流的开源框架如TensorFlow、PyTorch等,极大地降低了AI模型研发的门槛,加速了从理论到实践的转化。这些软件不仅封装了复杂的数学运算和并行计算能力,还通过模块化设计和丰富的预训练模型库,支持开发者快速构建和迭代各类应用,从计算机视觉、自然语言处理到强化学习。可以说,基础软件的成熟度直接决定了AI技术的普及速度与应用深度。其发展正朝着更加高效、易用、支持异构计算和云边端协同的方向演进。

二、 发展背后的数据安全隐忧

AI基础软件的强大能力高度依赖于数据。模型的训练需要大规模、高质量的数据集;模型的推理和应用则持续处理着实时流入的鲜活数据。这一过程引发了多重数据安全挑战:

- 数据隐私泄露风险:训练数据中可能包含大量个人敏感信息(如生物特征、行踪轨迹、健康记录等)。即使在数据脱敏后,先进的AI模型仍可能通过记忆和反演,从模型中推断出原始训练数据中的隐私信息。

- 数据污染与投毒攻击:恶意攻击者可能通过在训练数据中注入精心构造的“毒数据”,导致模型学习到错误模式,从而在关键应用中产生定向的误判或失效,威胁自动驾驶、金融风控等系统的安全。

- 模型窃取与逆向工程:通过API查询等方式,攻击者可能无需接触模型内部参数,仅通过大量输入输出对就能“窃取”或复制一个功能近似的模型,导致企业核心知识产权泄露。

- 供应链安全风险:AI开发严重依赖开源基础软件和第三方数据/模型库。其中若被植入后门或存在漏洞,将危及整个基于其上构建的应用生态安全。

三、 构筑安全与发展并重的路径

面对挑战,需要在人工智能基础软件的设计、开发与应用全周期内,嵌入数据安全与隐私保护的理念与实践:

- 技术原生融合安全:在基础软件层面集成隐私计算技术,如联邦学习、差分隐私、安全多方计算等。使得数据在“可用不可见”的前提下参与模型训练,从源头降低隐私泄露风险。开发框架应提供便捷的安全工具包,帮助开发者默认采用安全实践。

- 强化数据与模型治理:建立覆盖数据收集、存储、标注、使用、销毁的全生命周期安全管理体系。对训练数据进行严格的安全检测与清洗。对发布的模型进行安全性评估,包括抗攻击鲁棒性、隐私泄露风险测评等。

- 推动安全标准与法规建设:行业与监管机构需协同制定AI数据安全、模型安全的标准与测试规范。推动《网络安全法》、《数据安全法》、《个人信息保护法》在AI场景下的落地实施,明确各方责任,为安全开发提供法律框架。

- 构建协同防御生态:基础软件开发者、AI企业、安全研究人员和用户需形成合力。开源社区应加强安全审计与漏洞响应。鼓励发展专注于AI安全的第三方检测与防护工具,形成多层次的安全防御体系。

###

人工智能基础软件的蓬勃发展,正将智能化的未来加速带入现实。数据安全并非其发展的绊脚石,而是确保其行稳致远的护航舰。通过将安全能力深度融入基础软件的基因,通过技术、管理与法规的多维协同,我们完全有能力在充分释放人工智能巨大潜力的有效管控风险,守护好数据这一数字时代的核心资产,最终实现技术创新与社会安全的共赢。